朝、苦いコーヒーを飲みながら、スマートフォンのニュースアプリを眺めていると、AIが選んだ記事が次々と表示されます。なぜこの記事が選ばれたのか、その理由は教えてくれません。

初めは「また”見られて”いるな。」という気持ちの悪さを感じていました。

AIの判断基準が見えないことへの違和感は、私たちの日常にも通じるものがあります。会社での人事評価、学校での成績評価、医療での診断…どれも基準があるはずなのに、その全容を理解している人はほとんどいません。

ただ、AIの場合は少し事情が違います。

人間の判断には感情や直感、経験といったAIには理解不能(真似ることはできる)の要素が含まれています。一方、AIの判断は、理論的にはすべて数式とデータで説明できます。それなのに「企業秘密」や「複雑すぎて説明困難」という理由で、ブラックボックスのまま使われているケースが多いのです。

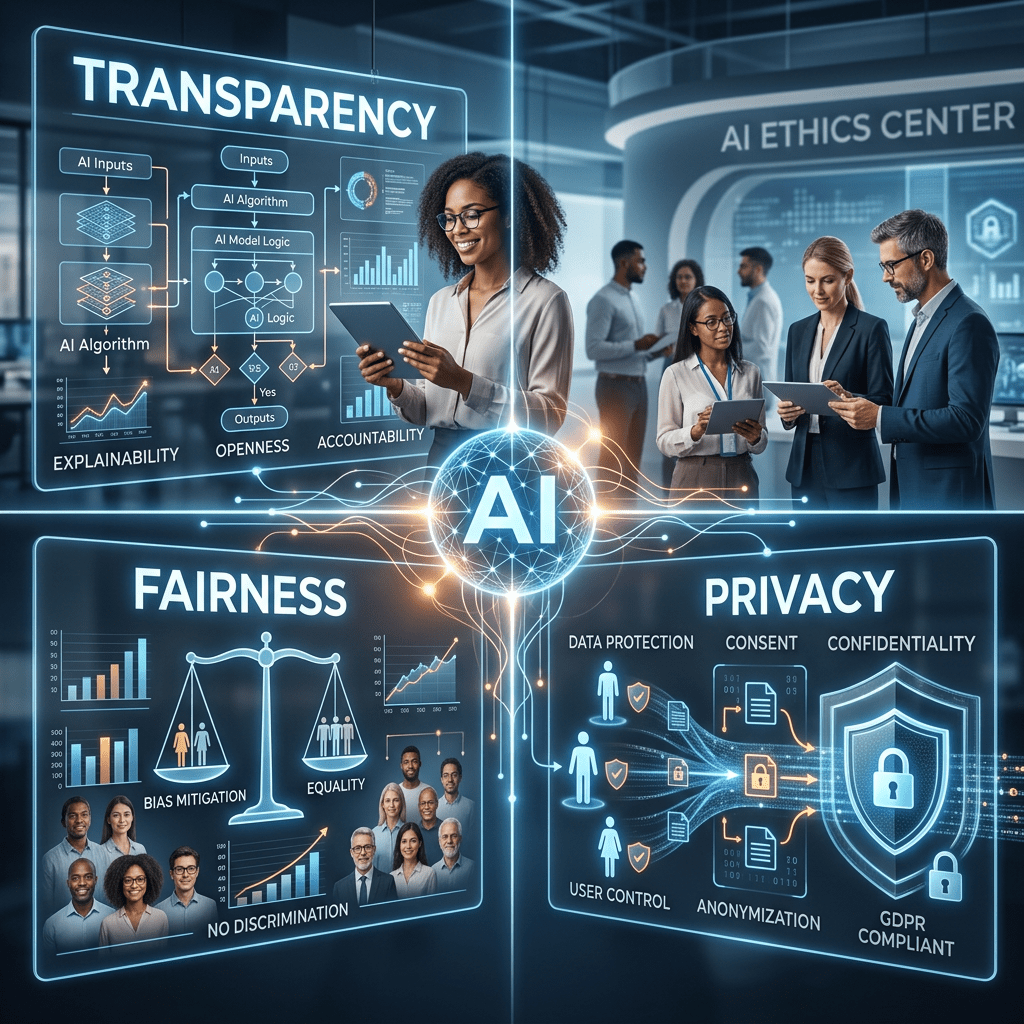

最近のAI倫理に関する研究では、透明性と公正性、プライバシーの三つが重要な柱として議論されています。これら三つの要素は時として対立することがあります。

たとえば、透明性を追求しすぎると、個人のプライバシーが侵害される可能性があります。公正性を重視すると、透明性が犠牲になることもあります(公正性を保つための複雑な調整が、かえって判断過程を見えにくくしてしまう)。

この三者の関係は、まるで三角形の各頂点のように、どれか一つを強調すると他の二つが影響を受ける関係にあります。

興味深いのは、このバランス感覚が国によって大きく異なることです。欧州連合はプライバシーと透明性を重視し、米国は経済効率と技術革新を優先し、中国は社会安定と国家管理を重んじる傾向があります。

見方を変えれば、どの立場も正しくどの立場も間違っています。

私たちがAIに求める倫理基準は、実のところ、私たち自身の価値観の反映でもあります。AIが不公正な判断をしたとき、それは本当にAIだけの問題なのでしょうか。そのAIを作り、データを提供し、使っているのは私たち人間です。

医療の現場で考えてみると、診断支援AIが特定の患者さんに対して偏った判断をする可能性があります。しかし、そのAIが学習したデータは、過去の医療記録から作られています。過去の医療に偏りがあれば、AIもその偏りを学習してしまいます。

AIの公正性の問題は、社会の公正性の問題そのものと言えます。ゆがんだ社会を学習していくAIはいずれひどくゆがんだものになるのではないか?

最近、子どもたちと話していて気づいたことがあります。彼らは「なぜ?」「どうして?」とよく聞きます。大人になった私たちは、いつの間にか説明されないことに慣れていて、経験から「意味がない」と判断することには興味を失ってしまっています。

これからは、AIの時代だからこそ、子どものような素朴な疑問を持ち続けることが大切なのかもしれません。

「なぜこの判断になったの?」「この基準は公正なの?」「私のデータはどう使われているの?」

これらの問いに答えられないAIシステムは、たとえ性能が優秀でも、本当に信頼できるシステムとは言えないでしょう。

透明性、公正性、プライバシー…この三つのバランスを取る作業は、技術的な問題である以前に、私たちがどんな社会を築きたいかという哲学的な問題です。

AIが普及すればするほど、私たちの価値観が試されることになります。便利さと引き換えに何を差し出すのか、効率性のために何を犠牲にするのか。

医療でも技術の進歩と人間的な配慮のバランスが常に問われています。AIの時代も同じです。技術の力を借りながら、人間らしさをどう保っていくか。あるいは新しい人間らしさを、どう創っていくか。

Anonymous. (2025) ‘AI Ethics: Integrating Transparency, Fairness, and Privacy in AI Development’, Applied Artificial Intelligence. Available at: https://www.tandfonline.com/doi/full/10.1080/08839514.2025.2463722