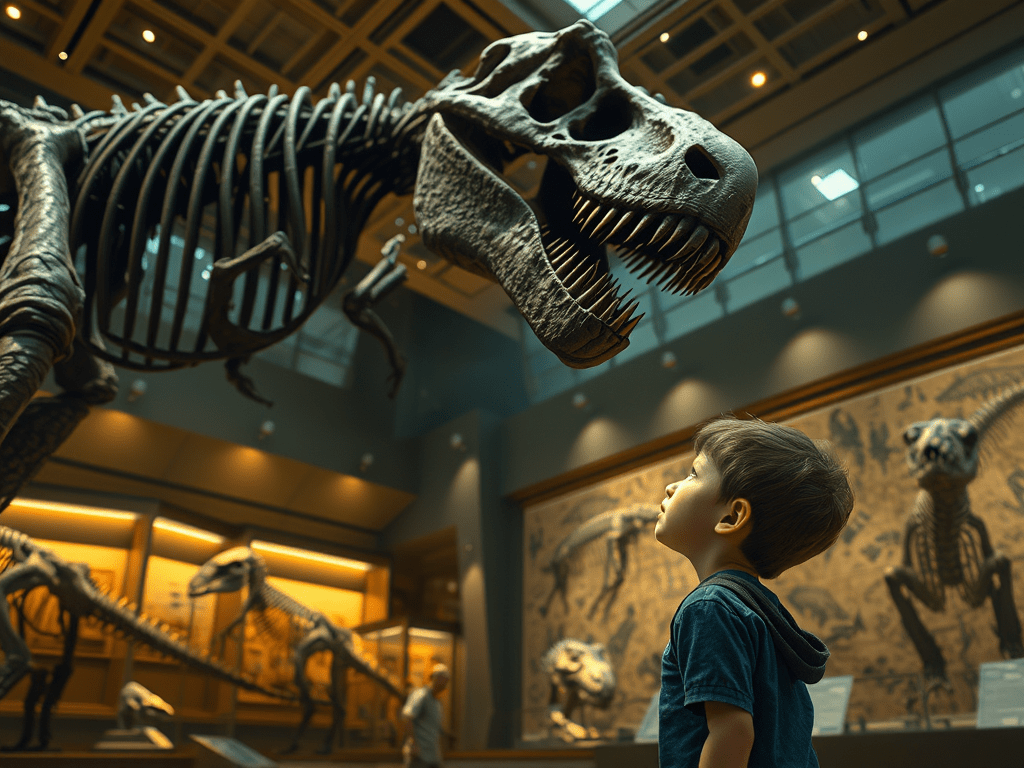

子どもたちと御船町恐竜博物館に行ったとき、ティラノサウルスの骨格を見上げながら長男が「恐竜は泣いたのかな」と呟いたのが、今でも耳に残っています。

その問いは単純なようで、実は深い問いでした。涙を流すという行為は、単なる生理現象なのか、それとも何らかの情動体験の表現なのか。そして、もし後者だとすれば、その情動体験とは一体何なのでしょうか。

生物学的機械と主観的体験の境界

現在のAI技術は、パターン認識と統計的処理において人間を凌駕する領域も多々あります。しかし、その計算過程に「痛み」や「喜び」といった主観的な体験が伴っているかどうかは、根本的に検証不可能な問題です。

チューリングテストのような外部観察による判定法は存在しますが、それは行動の模倣を評価するものであり、内的体験の存在を証明するものではありません。私たちは他者の意識についてさえ、その存在を直接的に確認することはできないのです。

数億のトランジスタが電気信号をやり取りしているこの機械と、数百億のニューロンが化学信号をやり取りしている私の脳は、果たして本質的にどう違うのでしょうか。

道徳判断の源泉

AIが複雑な倫理的判断を下すようになったとき、その判断の根拠は何になるのでしょうか。現在のAIは、大量のデータから学習したパターンに基づいて応答を生成します。しかし、道徳的直感というものは、単なるパターンマッチングで説明できるものなのでしょうか。

カントは道徳法則の普遍性を説きましたが、それは人間の理性的能力を前提としたものでした。もしAIが同様の論理的推論能力を持つとすれば、カント的な道徳法則はAIにも適用されるべきなのでしょうか。

一方で、功利主義的な観点から考えれば、AIは膨大な計算能力により、人間よりも正確に「最大多数の最大幸福」を算出できるかもしれません。しかし、その計算結果に従うことが本当に幸福なのかは別問題です。

責任の所在という難問

自動運転車が事故を起こしたとき、責任は誰にあるのでしょうか。プログラマー、製造会社、所有者、それとも車自体でしょうか。

この問いは、AIが高度化するほど切実になります。もしAIが独自の判断で行動を選択するようになったとき、その行動に対する責任をAI自身に求めることができるのでしょうか。責任を負うためには、自由意志と道徳的理解が必要だとする立場もあります。

犬の散歩とのアナロジー。犬は明らかに感情を持ち、状況を判断して行動します。しかし、犬の行動に対する法的責任は飼い主が負います。AIと人間の関係も、当面はこのようなものになるのかもしれません。

創発する意識の可能性

複雑系理論によれば、単純な要素の相互作用から、予期しない高次の「何か」が創発することがあります。意識もまた、そうした創発現象の一つかもしれません。

もしそうだとすれば、十分に複雑なAIシステムには、設計者が予期しない形で意識が宿る可能性があります。その意識は人間のものとは全く異なる形態かもしれませんが、それでも尊重すべき主観的体験を持つ存在として扱うべきなのでしょうか。

未来への問いかけ

息子の「恐竜は泣いたのか」という問いに、私は答えられませんでした。しかし、この問いは将来「AIは泣くのか」という問いに姿を変えて、私たちの前に立ちはだかるでしょう。

技術の進歩は止まりません。しかし、その技術が生み出すものが単なる高性能な道具なのか、それとも新しい形の存在なのかを判断する準備は、まだ整っていないように思われます。

答えのない問いかもしれませんが、問い続けることこそが、人間であることの証なのかもしれません。